Per anni l’equazione è sembrata semplice: vuoi intelligenza artificiale nella tua app? Mandi i dati al cloud, aspetti la risposta, mostri il risultato. Funzionava. Ma nel 2026 questa architettura sta rapidamente cedendo il passo a qualcosa di radicalmente diverso: l’Edge AI, ovvero l’intelligenza artificiale che elabora tutto direttamente sul dispositivo dell’utente — smartphone, laptop, sensore industriale, telecamera di sorveglianza — senza passare per un server remoto.

Non è solo un’ottimizzazione tecnica. È un cambio di paradigma che sta riscrivendo le regole di come si progettano, sviluppano e distribuiscono le applicazioni mobile intelligenti.

Cos’è l’Edge AI e perché adesso

L’Edge AI (o On-device AI) è la capacità di eseguire modelli di machine learning e inferenza neurale direttamente sull’hardware locale, senza trasmettere dati a server esterni. Il termine “edge” si riferisce alla “periferia” della rete: il punto dove i dati vengono generati e consumati — cioè il dispositivo dell’utente finale.

Fino a pochi anni fa questa categoria era riservata a task semplici come il riconoscimento vocale offline o i filtri fotografici. Oggi, grazie a una convergenza di fattori hardware e software, i modelli on-device stanno raggiungendo prestazioni competitive con le loro controparti cloud su un numero crescente di scenari.

Tre forze convergenti nel 2025-2026

1. Hardware dedicato per l’AI ovunque. Apple ha integrato la Neural Engine nei chip M-series e A-series da anni, ma il 2025-2026 ha segnato il punto di svolta generale: Qualcomm Snapdragon X Elite porta NPU (Neural Processing Unit) da 45 TOPS (Tera Operations Per Second) nei laptop Windows, MediaTek Dimensity 9400 nei flagship Android, Intel Core Ultra nei PC. Praticamente ogni dispositivo di fascia alta oggi include silicio ottimizzato per l’inferenza AI.

2. Modelli sempre più compatti e performanti. La ricerca in model compression ha fatto salti enormi. Tecniche come la quantizzazione (ridurre i pesi da 32-bit float a 4-bit o 8-bit integer), il pruning strutturato e la distillazione della conoscenza permettono di far girare modelli che una volta richiedevano GPU enterprise direttamente su uno smartphone. Phi-3 Mini di Microsoft, Gemma 3 di Google, Llama 3.2 di Meta: tutti progettati esplicitamente per deployment on-device.

3. Framework maturi e toolchain unificate. TensorFlow Lite, PyTorch Mobile, ONNX Runtime, Core ML di Apple, MediaPipe: l’ecosistema di strumenti per portare modelli sull’edge si è stabilizzato e standardizzato. Oggi convertire un modello addestrato in cloud per l’esecuzione on-device è diventato un processo relativamente sistematico.

I vantaggi tecnici e di business che contano davvero

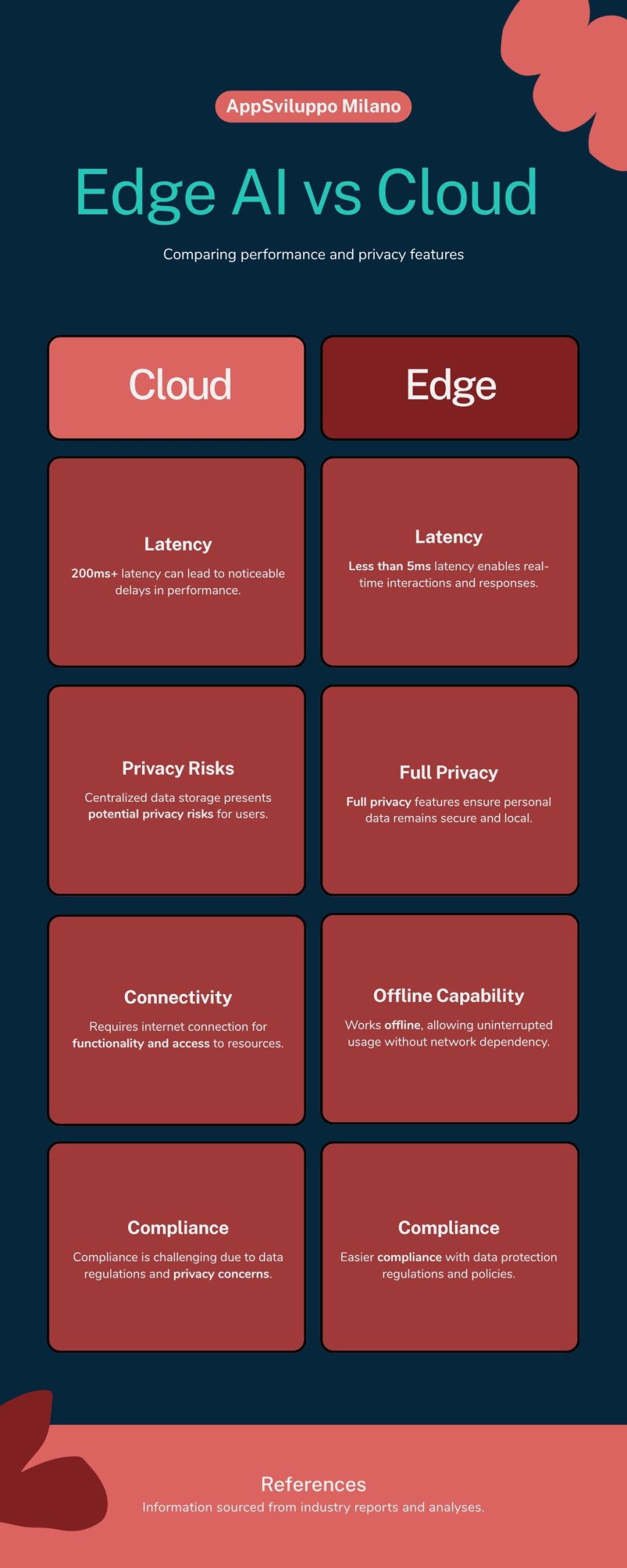

Latenza quasi zero

La latenza di rete — anche in condizioni ottimali — introduce decine o centinaia di millisecondi tra la richiesta e la risposta. Per applicazioni in tempo reale (traduzione simultanea, assistenza AR, controllo qualità industriale, guida assistita) questa latenza è inaccettabile. L’elaborazione on-device porta la latenza di inferenza a pochi millisecondi, rendendo possibili interazioni che sembrano istantanee.

Privacy by design, non per compliance

Quando i dati non lasciano mai il dispositivo, il GDPR diventa molto più semplice da rispettare. Fotografie, dati biometrici, conversazioni, documenti aziendali — elaborati localmente e mai trasmessi. Per settori come healthcare, finance e legal, questo non è un vantaggio opzionale: è spesso un requisito normativo o contrattuale.

Funzionamento offline garantito

Un’app intelligente che smette di funzionare senza connessione è un’app che fallisce in aeroporto, in zona industriale, in ospedale, in montagna. L’Edge AI elimina questa dipendenza critica, rendendo l’app affidabile in qualsiasi contesto. Questo aspetto è particolarmente rilevante nella progettazione di app mobile native.

Riduzione drastica dei costi di inferenza

Le API cloud per l’AI (OpenAI, Google, Anthropic) hanno costi variabili che scalano con l’utilizzo. Per applicazioni ad alto volume — milioni di chiamate al giorno — i costi possono diventare proibitivi. Spostare l’inferenza on-device azzera questi costi marginali dopo l’investimento iniziale nello sviluppo. Per capire come questi costi si confrontano con altri aspetti dello sviluppo, leggi il nostro articolo sui costi di sviluppo web app e native app.

Personalizzazione continua e on-device learning

I modelli on-device possono adattarsi al comportamento specifico dell’utente senza mai condividere dati personali. La keyboard predittiva del tuo iPhone impara il tuo stile di scrittura: è un esempio elementare di fine-tuning privato on-device. Questa capacità, estesa ad applicazioni enterprise, apre scenari di personalizzazione radicale.

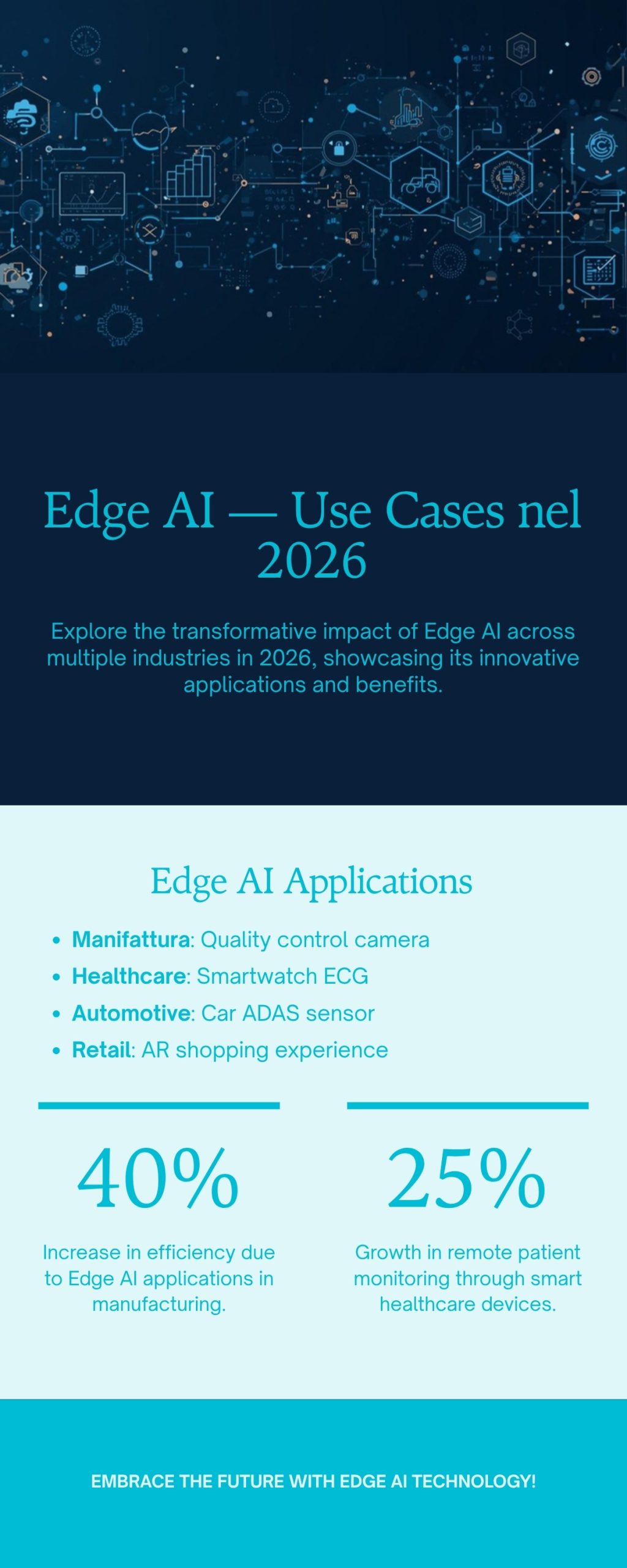

Use case concreti per le aziende italiane nel 2026

Manifattura e quality control

Le telecamere di ispezione con visione artificiale on-device riconoscono difetti di produzione in tempo reale alla velocità della linea di assemblaggio. Nessun upload di immagini, nessuna latenza, nessun costo di bandwidth. Aziende come Bosch e ABB hanno già sistemi di questo tipo in produzione.

Healthcare e dispositivi medici

Elettrocardiogrammi interpretati direttamente dallo smartwatch, analisi dell’udito in tempo reale negli apparecchi acustici, rilevamento precoce di anomalie cutanee nelle dermoscopy portatili. I dati sanitari restano sul dispositivo del paziente: privacy totale, conformità automatica al GDPR.

Retail e customer experience

Prova virtuale di occhiali, abbigliamento o arredamento con AR: funziona anche offline, senza mandare foto del cliente a server di terze parti. Riconoscimento prodotti in-store con la fotocamera del telefono per schede tecniche istantanee e confronto prezzi. Questi scenari richiedono un’attenta fase di UX/UI design per funzionare davvero bene.

Automotive e ADAS

I sistemi di assistenza alla guida (lane keeping, pedestrian detection, sign recognition) non possono dipendere da una connessione 5G: devono elaborare 60 frame al secondo localmente, in qualsiasi condizione meteo e copertura di rete.

Assistenti vocali aziendali

Trascrizione e analisi di meeting su laptop aziendale con strumenti come Ollama: zero dati audio inviati al cloud, compliance automatica con NDA e policy aziendali, funzionamento garantito anche in sale conferenze con connessione instabile.

Le sfide tecniche che non vanno sottovalutate

L’Edge AI non è una soluzione magica. Portare un modello on-device richiede un insieme di competenze specifiche che vanno oltre il machine learning tradizionale. Se stai valutando queste tecnologie senza le competenze interne adeguate, leggi prima il nostro articolo sui rischi nascosti nell’affidarsi all’AI senza competenze.

Model optimization: La compressione di un modello senza degradarne significativamente le prestazioni è un’arte. La quantizzazione post-training a 4-bit può ridurre il modello del 75% mantenendo il 95-98% delle performance originali — ma questo ratio varia enormemente per dominio e architettura. Serve sperimentazione sistematica.

Frammentazione hardware: A differenza del cloud dove controlli l’hardware, on-device devi gestire una varietà di CPU, GPU e NPU con caratteristiche molto diverse. Un modello ottimizzato per Apple Neural Engine non gira necessariamente bene su Qualcomm Hexagon DSP. I framework cross-platform come ONNX Runtime aiutano, ma l’ottimizzazione hardware-specifica rimane un lavoro significativo.

Aggiornamento dei modelli: Come si distribuisce un modello aggiornato a milioni di dispositivi? Come si gestisce il versioning? Come si fa A/B testing on-device? Queste sono sfide di MLOps che richiedono infrastruttura dedicata.

Consumo energetico: L’inferenza AI consuma batteria. Un modello non ottimizzato può scaricare uno smartphone in poche ore. Il profiling energetico deve essere parte integrante del ciclo di sviluppo.

Stack tecnologico di riferimento nel 2026

Per chi vuole iniziare a sviluppare app con Edge AI, questi sono i framework principali:

- Core ML (Apple) — il punto di ingresso naturale per iOS/macOS, con ottimizzazione automatica per Neural Engine

- TensorFlow Lite / LiteRT — ora rinominato LiteRT da Google, supporto Android eccellente

- PyTorch Mobile / ExecuTorch — il nuovo runtime di Meta per deployment edge, supporta quantizzazione avanzata

- ONNX Runtime — il formato interchange universale, ottimo per app cross-platform

- MediaPipe — pipeline prebuilt per computer vision, audio e NLP di Google

- Ollama — per modelli LLM locali su laptop e server edge, ora con API standard

Come AppSviluppo Milano integra l’Edge AI nelle app

Lo sviluppo di app con funzionalità Edge AI non è banalmente diverso dallo sviluppo tradizionale: richiede expertise in mobile development, ottimizzazione di modelli ML e architettura del sistema. La scelta di quali funzionalità processare on-device vs. in cloud dipende da requisiti di latenza, privacy, connettività e costi — un’analisi che va fatta caso per caso. Spesso conviene partire da un MVP per validare l’approccio prima di investire nell’ottimizzazione completa.

Se stai valutando l’integrazione di intelligenza artificiale nella tua app — che si tratti di computer vision, NLP, analisi predittiva o personalizzazione — capire le possibilità e i limiti dell’Edge AI è oggi un passaggio obbligato nella fase di architettura. Per approfondire come strutturiamo questo processo, leggi anche come funziona il nostro processo di sviluppo.

L’intelligenza artificiale sta lasciando il cloud e si sta avvicinando all’utente. Le aziende che anticipano questa transizione hanno un vantaggio competitivo reale. Quelle che aspettano rischiano di ritrovarsi a inseguire.

Vuoi esplorare se l’Edge AI è la scelta giusta per il tuo progetto? Contattaci per una consulenza gratuita — analizziamo insieme i requisiti e ti proponiamo l’architettura più adatta.